matrisprodukt 0 när vektorerna är ortogonala

Finns det någon förklaring till varför matrisprodukten mellan två matriser som har vektorer som är ortogonala mot varandra är noll?

Jag förstår när det gäller skalärprodukt men fattade inte förrän nyligen att det gäller för matrisprodukt med.

Tacksam för hjälp!

Menar du att om kolonnerna hos matris A är ortogonala mot kolonnerna hos matris B så är matrisprodukten AB lika med nollmatrisen?

Är kolonnerna hos A sinsemellan ortogonala? Är kolonnerna hos B sinsemellan ortogonala?

Albiki skrev:Menar du att om kolonnerna hos matris A är ortogonala mot kolonnerna hos matris B så är matrisprodukten AB lika med nollmatrisen?

Är kolonnerna hos A sinsemellan ortogonala? Är kolonnerna hos B sinsemellan ortogonala?

Sorry att jag var otydlig. Menar att om kolonnerna hos matris A är ortogonala mot kolonnerna hos matris B så är matrisprodukten AB lika med nollmatrisen.

Finns det någon förklaring på det eller är det bara acceptera?

Jag kan visa att om kolonnvektorerna hos är ortogonala mot kolonnvektorerna hos så är matrisen lika med nollmatrisen, men det var ju inte vad du ville visa så det får nog bli någon annan som kan hjälpa dig med det.

Menar du t.ex. ?

Albiki skrev:Jag kan visa att om kolonnvektorerna hos är ortogonala mot kolonnvektorerna hos så är matrisen lika med nollmatrisen, men det var ju inte vad du ville visa så det får nog bli någon annan som kan hjälpa dig med det.

Ja, det är vad jag försöker förstå, men hur hänger det ihop med att är lika med nollmatrisen?

Laguna skrev:Menar du t.ex. ?

Ja, ser att det stämmer men kan man visa det på något sätt?

lamayo skrev:Laguna skrev:Menar du t.ex. ?

Ja, ser att det stämmer men kan man visa det på något sätt?

Produkten är .

Laguna skrev:lamayo skrev:Laguna skrev:Menar du t.ex. ?

Ja, ser att det stämmer men kan man visa det på något sätt?

Produkten är .

Oj jag körde skalärprodukt. Så det stämmer alltså inte?

lamayo skrev:Laguna skrev:lamayo skrev:Laguna skrev:Menar du t.ex. ?

Ja, ser att det stämmer men kan man visa det på något sätt?

Produkten är .

Oj jag körde skalärprodukt. Så det stämmer alltså inte?

Det stämmer inte. Vad menar du med skalärprodukt här?

Hej!

Laguna har visat att det inte är sant att när kolonnerna hos och är ortogonala mot varandra.

Däremot är det sant att när kolonnerna hos och är ortogonala mot varandra.

Till exempel är matrisprodukten

Elementet på rad nummer och kolonn nummer är lika med skalärprodukten mellan kolonnvektor nummer från och kolonnvektor nummer från .

Albiki skrev:Elementet på rad nummer och kolonn nummer är lika med skalärprodukten mellan kolonnvektor nummer från och kolonnvektor nummer från .

Tack så mycket nu förstår jag ! :)

Albiki skrev:Hej!

Laguna har visat att det inte är sant att när kolonnerna hos och är ortogonala mot varandra.

Däremot är det sant att när kolonnerna hos och är ortogonala mot varandra.

Till exempel är matrisprodukten

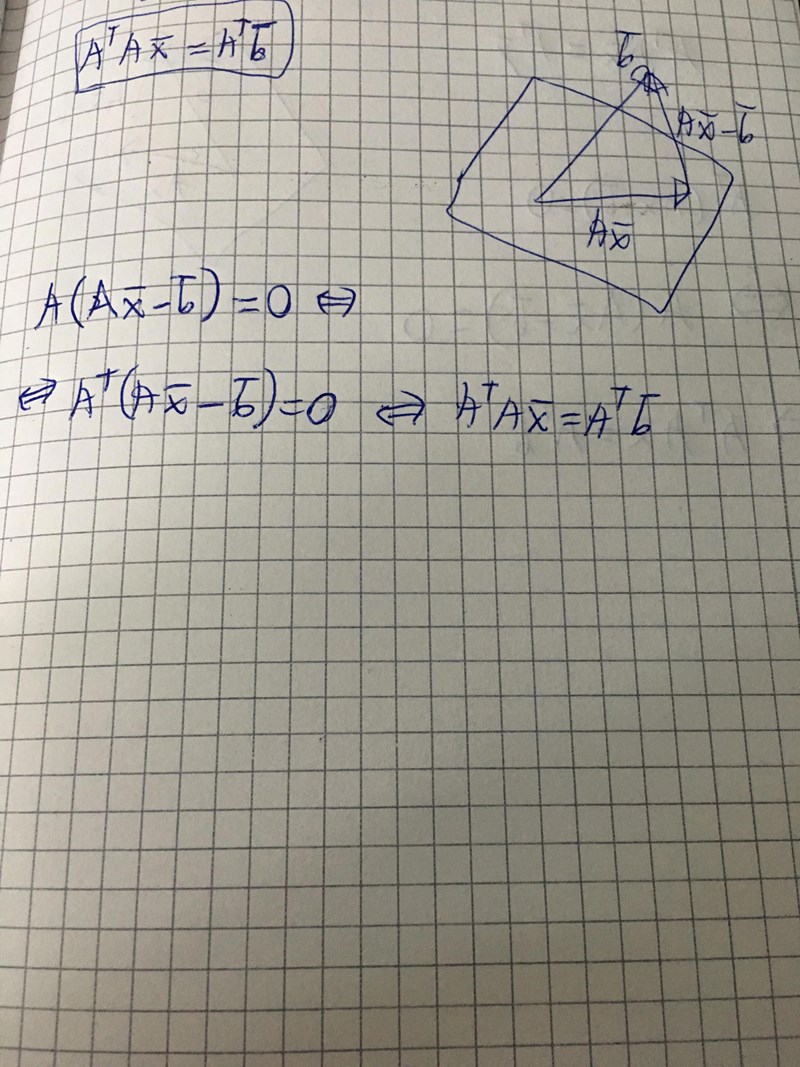

Jag har två följdfrågor. Kollade på härledningen för normalekvationen till minsta kvadratmetoden och där står det såhär:

1) Hur kommer det sig att är samma som

2) O varför tar man inte

lamayo skrev:Hur kommer det sig att är samma som

Det är inte samma sak. Med den vanliga notationen så är det inte säkert att VL i den första ekvationen ens är definierat.

Hej!

Det du har skrivit är inte en härledning av normalekvationerna. Det gäller inte att vektorn ligger i nollrummet till .

Om du vill härleda normalekvationerna på riktigt så ska du finna den vektor som minimerar avståndet mellan vektorerna och . Låt beteckna vektorn

.

Det du ska visa är ekvivalensen

Albiki skrev:Hej!

Det du har skrivit är inte en härledning av normalekvationerna. Det gäller inte att vektorn ligger i nollrummet till .

Om du vill härleda normalekvationerna på riktigt så ska du finna den vektor som minimerar avståndet mellan vektorerna och . Låt beteckna vektorn

.

Det du ska visa är ekvivalensen

Okej, men det minsta avståndet bör väll vara Ax•Ax-b? Kommer dock inte fram till normalekvationen med det

Hur kommer du fram till just det avståndet?

och vilken vektor är i detta uttryck?

Albiki skrev:Hur kommer du fram till just det avståndet?

och vilken vektor är i detta uttryck?

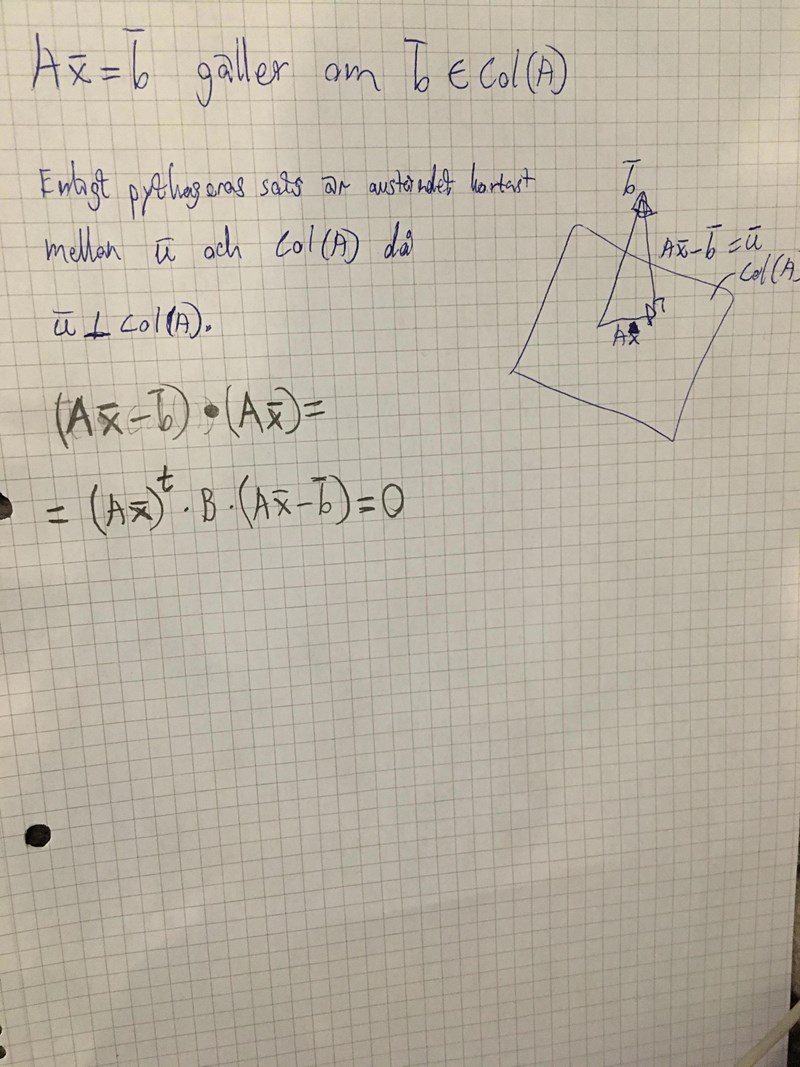

Jag ritade i mitt svar ovan vektorerna och tänkte att det kortaste avståndet är när Ax och Ax-b är ortogonala och satte därför skalärprodukten lika med 0. Varför blir det fel?

lamayo skrev:Albiki skrev:Hur kommer du fram till just det avståndet?

och vilken vektor är i detta uttryck?

Jag ritade i mitt svar ovan vektorerna och tänkte att det kortaste avståndet är när Ax och Ax-b är ortogonala och satte därför skalärprodukten lika med 0. Varför blir det fel?

Det är din uppgift att visa varför det är rätt att göra så.

Det kanske råkat bli ett tryckfel i härledningen eftersom antag att

värderummet av A

då är

.

Inses eftersom projicerar en vektor på värderummet av A. Vektorn kan uttryckas med vektorn som då ger normalekvationen.

Nu har jag gjort såhär men det blir fel när jag tar skalärprodukten men jag använde att a•b=a^t*A*b, borde det inte funka?

Några frågor om din bild:

1. Varför ligger b i kolonnrummet till A?

2. Varför är Ax ortogonal projektion av b på kolonnrummet till A?

3. Hur får du att Pythagoras sats säger att avståndet mellan Ax-b och kolonnrummet till A är minst då Ax-b är ortogonal mot kolonnrummet?

4. Vektorn u borde vara b-Ax istället för Ax-b?

Albiki skrev:Några frågor om din bild:

1. Varför ligger b i kolonnrummet till A?

2. Varför är Ax ortogonal projektion av b på kolonnrummet till A?

3. Hur får du att Pythagoras sats säger att avståndet mellan Ax-b och kolonnrummet till A är minst då Ax-b är ortogonal mot kolonnrummet?

4. Vektorn u borde vara b-Ax istället för Ax-b?

1. Det är meningen att den inte gör det, glömde skriva att b i det här fallet inte tillhör Col(A).

2. Tänkte eftersom det kortaste avståndet är när Ax-b är ortogonal mot kolonnrummet.

3. Eftersom den säger att hypotenusan är längre än kateterna och om avståndet mellan kolonrummet och b inte är ortogonal blir om man bildar en rätvinklig triangel avståndet hypotenusan medan om avståndet är ortogonal och man bildar en rätvinklig triangel så är det en katet.

4. Ja, gjorde fel.

Läs det du skrev under 3. en gång till. Låter det begripligt för dig? För mig låter det som rappakalja.

Albiki skrev:Läs det du skrev under 3. en gång till. Låter det begripligt för dig? För mig låter det som rappakalja.

Har kollat på flera bevis och det jag inte fattar är A^t(-A)=0 och varför x är en vektor och inte skalär, kolonnvektorerna är ju i A. Men det måste väll vara så att de använder sig av att

Men vad är M i matrisen?

lamayo skrev:Har kollat på flera bevis och det jag inte fattar är A^t(-A)=0 och varför x är en vektor och inte skalär, kolonnvektorerna är ju i A. Men det måste väll vara så att de använder sig av att

Men vad är M i matrisen?

Du måste väl förstå att med sådana inlägg finns det ingen som kan hjälpa dig? Hur i all sin dar ska vi kunna veta vad M är? Jag förstår inte varför du vill hemlighålla det bevis som du tittar på? Det är ingen statshemlighet hur minsta-kvadratmetoden fungerar vet du.

Albiki skrev:lamayo skrev:Har kollat på flera bevis och det jag inte fattar är A^t(-A)=0 och varför x är en vektor och inte skalär, kolonnvektorerna är ju i A. Men det måste väll vara så att de använder sig av att

Men vad är M i matrisen?

Du måste väl förstå att med sådana inlägg finns det ingen som kan hjälpa dig? Hur i all sin dar ska vi kunna veta vad M är? Jag förstår inte varför du vill hemlighålla det bevis som du tittar på? Det är ingen statshemlighet hur minsta-kvadratmetoden fungerar vet du.

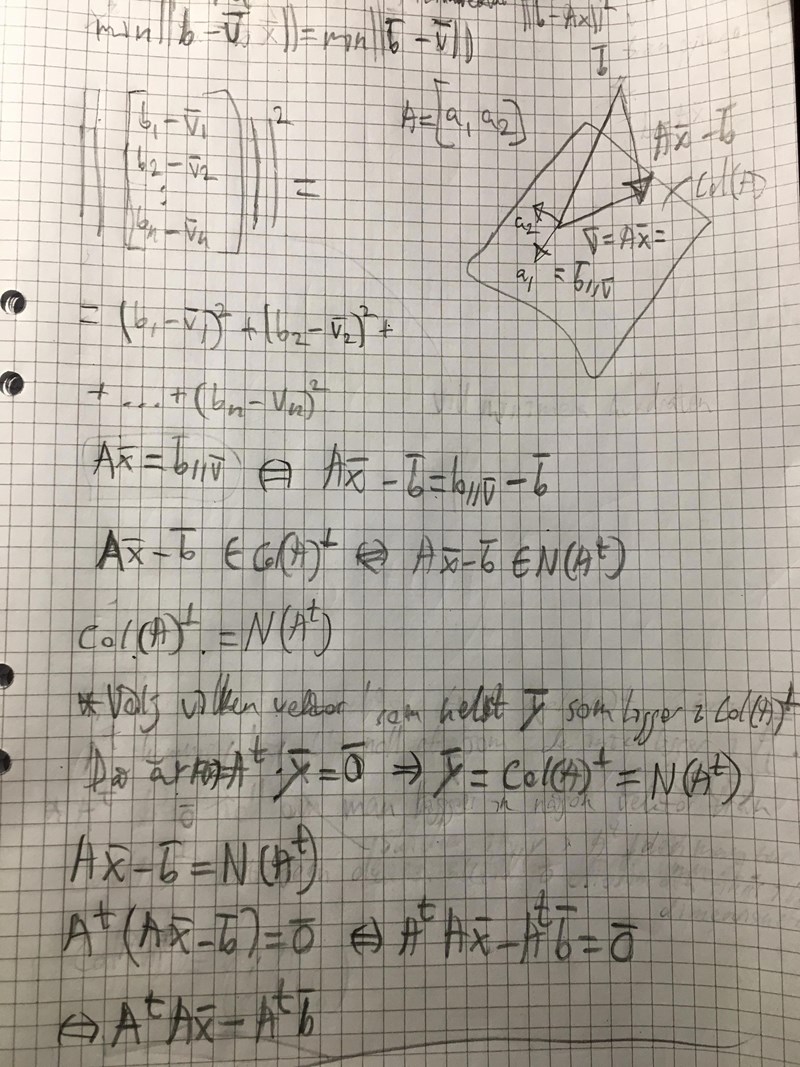

Sorry. Här är det beviset jag skrivit ner. Varför blir ?

lamayo skrev:Har kollat på flera bevis och det jag inte fattar är A^t(-A)=0 och varför x är en vektor och inte skalär, kolonnvektorerna är ju i A. Men det måste väll vara så att de använder sig av att

Men vad är M i matrisen?

Du får läsa mer grundläggande linjär algebra innan du försöker förstå minsta kvadratmetoden. är en vektor eftersom är en vektor då måste vara en vektor. Det är viktigt med grundförståelse för att kunna följa bevis eller kunna fråga om hjälp. Sitta och gissa hejvilt och hitta på ekvationer som inte fungerar för att sedan fråga varför dessa inte ger rätt svar är meningslöst. Läs på det grundläggande tills det sitter i ryggmärgen. Det vinner du mycket på.

Din specifika fråga är alltså denna: Låt vara en matris med rader och kolonner av reella tal. Varför gäller det att det ortogonala komplementet till matrisens kolonnrumm är samma mängd som nollrummet till matrisens transponat ?

Albiki skrev:Din specifika fråga är alltså denna: Låt vara en matris med rader och kolonner av reella tal. Varför gäller det att det ortogonala komplementet till matrisens kolonnrumm är samma mängd som nollrummet till matrisens transponat ?

Ja.

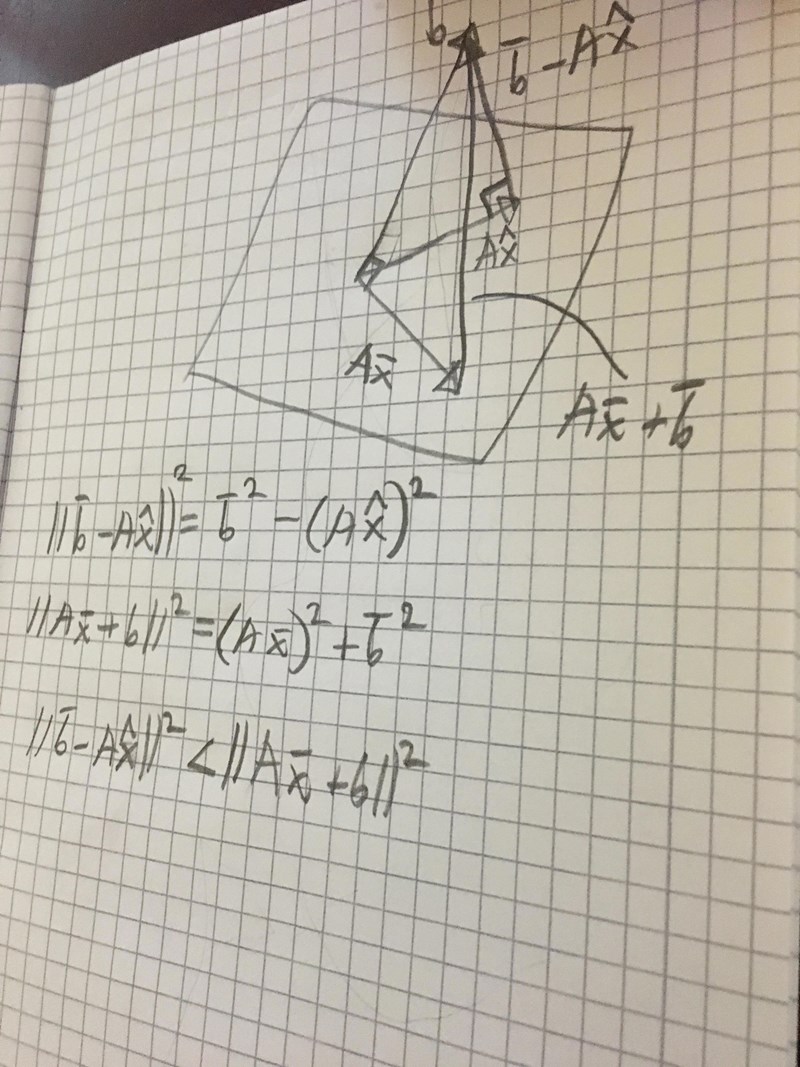

Det gäller att varje vektor i kan skrivas som en summa av två vektorer från kolonnrummet och från dess ortogonala komplement.

För vektorn betyder det att den kan skrivas

där och . Vektorn ligger i kolonnrummet till så vektorn kan skrivas som summan

Pythagoras sats ger avståndet

Om det stämmer att så följer det att

eftersom är nollvektorn.

Från Pythagoras sats ser man att avståndet aldrig kan bli mindre än och att detta minsta avstånd uppnås då (nollvektor). Från sambandet följer det då att en sådan vektor uppfyller ekvationssystemet (normalekvationerna)

Om matrisen är inverterbar ges vektorn av .

- Låt vara en godtycklig vektor och vara en godtycklig vektor. Då följer det att skalärprodukten och detta kan skrivas som matrismultiplikation Detta gäller för godtyckligt och därför följer det att (nollvektor).

Detta visar att

- Om så följer det att för varje vektor , vilket betyder att är ortogonal mot varje linjärkombination av kolonnerna till matrisen .

Detta visar att

Beräkningarna visar att är projektionen av på kolonnrummet till matrisen och att är projektionen av på kolonnrummets ortogonala komplement.

Att det som sägs vara projektion på kolonnrummet verkligen är en projektion går att kontrollera genom att verifiera att "projektionen" är idempotent.

Alla projektioner () är idempotenta, .

Albiki skrev:Att det som sägs vara projektion på kolonnrummet verkligen är en projektion går att kontrollera genom att verifiera att "projektionen" är idempotent.

Alla projektioner () är idempotenta, .

Tack Albiki! Det klarnade upp nu efter att ha läst igenom några gånger.

Bra att det klarnade tillslut.